Over Kunstmatige intelligentie (AI) wordt wel gezegd: “de Chinezen maken de computers, de Amerikanen maken de software, Europa maakt de regels”. Moeten we nu met AI niet vooral meters maken en ons niet zo blindstaren op ethiek, privacy en andere regelgeving?

Toen ik aan mijn studie Elektrotechniek begon, kon ik mij niet voorstellen dat beta-onderwerpen ooit met juridische dingen te maken konden krijgen. Ook andersom was die link niet voor de hand liggend: de rechtenfaculteit waar mijn vrouw toen studeerde, was de laatste die nog geen computers gebruikte – en ze waren daar trots op.

Dat is veranderd. Toen één van mijn kinderen levensmiddelentechnologie in Wageningen ging studeren en zich specialiseerde zich in voedselveiligheid, zag ik opeens dikke boeken ‘Food Law’ op tafel liggen. Toen realiseerde ik mij dat voedselveiligheid een nuttige vergelijking is voor het toch wat abstracte gesprek over de AI Verordening.

Door de enorme hoeveelheid innovatie in onze voedselvoorziening, die (vooral vanuit Wageningen) na de oorlog beschikbaar gekomen is, hebben we nu betaalbaar voedsel in overvloed. Het is ook nog eens heel veilig. Je kunt voedsel dat in Nederland aangeboden wordt, zonder zorgen in je mond stoppen: het is niet verontreinigd met rare stoffen en allergenen zijn keurig op het etiket vermeld. De langere termijn gezondheidseffecten zijn ook geregeld: naast de voedingswaardetabel is er nu ook de Nutri-score. Je kunt nog steeds ongezond eten, maar met een beetje achtergrondkennis kun je op basis van de informatie zelf bedenken dat je misschien betere keuzes kunt maken.

Hoe anders is dat met data en AI. Deze zijn in grote hoeveelheden vooral vanuit Silicon Valley na de dotcom-bubble begin jaren 2000 beschikbaar gekomen. We hebben nu gratis diensten in overvloed, waarvan we eigenlijk geen idee hebben of ze wel veilig zijn. Is de informatie die je in je hoofd stopt wel te vertrouwen? Waar komt die eigenlijk vandaan?

Is voedsel gezond en veilig? Is AI verantwoord en zonder risico’s?

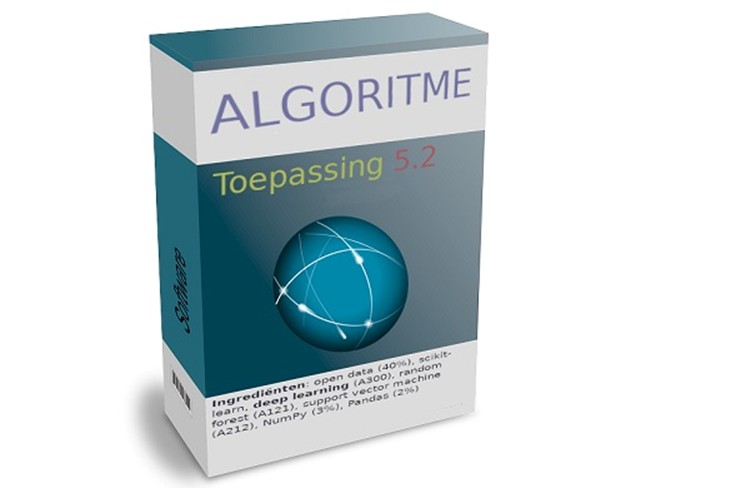

Denk aan een soort ingrediëntendeclaratie voor AI. Het is nu nog onduidelijk met welk recept de informatie gemaakt is: een Large Language Model dat op rare teksten getraind is, of een social media algoritme dat je de fabeltjesfuik inlokt. De mentale gezondheidseffecten op langere termijn zijn volstrekt onduidelijk. Wat is de ‘voedingswaarde’ van de output van AI?

Toen voedsel in de tweede helft van de 20e eeuw steeds meer industrieel geproduceerd werd, raakten we het zicht op de productie ervan kwijt en moesten er strenge regels worden gesteld aan de voedselverwerkende industrie. Ook moest de consument opgevoed worden: wat zijn kilocalorieën, wat is verzadigd vet, wat zijn eiwitten eigenlijk? Want veilig voedsel betekent niet per se gezond voedsel.

Het is daarom logisch dat de Europese Commissie de ‘food for thought’ net zo wil reguleren als onze ‘food for body’. Voor hoog-risico AI toepassingen zijn er strenge eisen aan de ‘fabriek’: die moet inzicht geven in het productieproces en de ingrediënten (de trainingsdata). Er komt een etiketteringsplicht voor AI-systemen die direct met menselijke eindgebruikers te maken hebben.

Opvallend is dat in sommige gevallen niet alleen het eindproduct, maar ook de bereidingswijze ervan gereguleerd is: de ‘General Purpose AI Models’ zoals ChatGPT die opeens opdoken terwijl de AI Verordening al grotendeels geschreven was.

Ook is er een soort Voedsel en Waren Autoriteit: naast de European AI Office komt er in elk EU-land een autoriteit die toezicht houdt op AI. De belangrijkste handhaving van de AI Act is nationaal, maar sommige taken gaat de AI Office doen, zoals het monitoren van breed toepasbare (General Purpose) AI. De reden daarvoor is dat het een zogenaamd ‘systemisch risico’ kan hebben: grootscheepse invloed op hoe burgers informatie voorgeschoteld krijgen en daarmee hun geestelijke gezondheid. Het lijkt logisch om dit op EU-niveau te doen.

Zo kunnen we regelen dat de output van AI-systemen in basis veilig is en blijft. Net zoals je van thuiskoks basiskennis mag verwachten over voedselveiligheid, is het ook nodig dat de gebruikers van al die AI-systemen achtergrondkennis hebben. Wat is een AI-systeem eigenlijk? Wat kan ik wel verwachten, wat kan ik niet verwachten? Wat is het verschil tussen data, een model, de user interface? We moeten, kortom, werken aan ‘AI geletterdheid’.

Daarvoor is het niet nodig dat alle burgers in Europa opeens programmeurs worden. Net zoals we geen levensmiddelentechnologen hoeven te zijn om te snappen dat een geopend potje augurken dat je buiten de koelkast bewaart, na een tijdje gaat schimmelen. (We zijn goed bezig als er ook voor AI TV-programma’s komen als de Smaakpolitie of Keuringsdienst van Waarde.)

Het zal allemaal niet perfect zijn – sterker nog, er is serieuze kritiek op de AI Verordening mogelijk. De Nutri-score is zeker niet toereikend en zelfs als die dat wel zou zijn: mensen kunnen zich nog steeds volstoppen met ongezond voedsel. De AI Verordening gaat ons dus vast ook niet helemaal afhelpen van fabeltjesfuiken en nepnieuws – maar het is een stap in de goede richting.

Plaats een reactie